深夜のコーヒー片手に、AI の世界に踏み込んだ夜

2022年の秋、私は自宅のデスクで途方に暮れていた。

本業のWebエンジニアとしては10年以上やってきて、HTML、CSS、JavaScriptはもちろん、PHPやPythonもそこそこ書ける。でも、最近クライアントから「AIを使った機能を実装したい」って相談が増えてきて、正直に言うと焦ってた。

「機械学習って、数学できないと無理でしょ…」

そんな風に思いながらも、YouTubeで機械学習の解説動画を見てたら、強化学習っていう分野が目に留まった。AlphaGoが囲碁の世界チャンピオンを破ったニュースは知ってたけど、あれも強化学習だったんだって。

で、試しにPythonで簡単な強化学習のコードを書いてみた。迷路を解くAIを作るやつ。最初は全然動かなくて、エラーばっかり。でも、3時間くらい格闘してたら、突然AIが最短ルートを見つけた瞬間があった。

「お、おお…!動いた!」

深夜2時、思わず声が出た。隣の部屋で寝てる家族に申し訳ないと思いつつ、興奮が収まらなかった。

あれから2年。今は強化学習のスキルを活かして、副業で月20万円くらい稼いでる。クライアントの業務最適化システムや、簡単なゲームAIの実装とか。時給換算で5,000円くらい。Web制作だけやってた頃の倍以上だ。

この記事では、「強化学習って何?」「Pythonでどうやって実装するの?」「副業で稼げるの?」って疑問を持ってる人に向けて、私が実際に学んで実践してきたことを全部話していく。

プログラミングの基礎ができる人なら、強化学習は思ってるより敷居が低い。むしろ、今学び始めれば先行者利益が取れる分野だと思ってる。需要が供給を完全に上回ってるから。

実際、私がメンターしてる受講生の中にも、強化学習を学んで半年で初案件取った人が何人もいる。みんな最初は「数学が…」って言ってたけど、実際やってみたら意外とできたって感想だった。

強化学習って結局何なの?機械学習との違いは?

AIが試行錯誤しながら学ぶ仕組み

強化学習を一言で言うと、「AIが自分で試行錯誤しながら、報酬を最大化する行動を学ぶ」っていう学習方法。

教師あり学習は、正解データを大量に用意して「これが正解ですよ」って教えるやり方。画像認識とかで使われる。一方で、強化学習は正解を直接教えない。代わりに「この行動をしたら+10点」「失敗したら-5点」みたいに報酬だけ与える。

例えば、ゲームのAIを作るとする。教師あり学習なら「このシーンではこのボタンを押す」っていう正解データを何万個も用意する必要がある。でも強化学習なら、「敵を倒したら+100点」「ダメージ受けたら-50点」って報酬を設定するだけ。あとはAIが勝手に試行錯誤して、高得点を取る方法を学んでいく。

これ、人間の学び方に近い。赤ちゃんが歩き方を覚えるのと同じで、転んだら「痛い(マイナス報酬)」、うまく歩けたら「褒められる(プラス報酬)」を繰り返して学習していく。

強化学習の基本要素:5つのキーワード

強化学習を理解する上で、絶対に押さえておくべき5つの要素がある。

エージェント

学習する主体。ゲームで言えば、プレイヤーキャラクター。人間の代わりにプレイするAIのこと。

環境

エージェントが行動する世界。ゲームのマップや、株式市場のデータとか。エージェントはこの環境と相互作用する。

状態(State)

エージェントが置かれている現在の状況。迷路で言えば「今どのマスにいるか」、ゲームで言えば「HP、位置、敵の配置」とか。

行動(Action)

エージェントが取れる選択肢。「上に進む」「右に進む」「ジャンプする」「攻撃する」とか。

報酬(Reward)

行動の結果として得られる評価値。ゴールに着いたら+100、壁にぶつかったら-10みたいな感じ。

この5つの要素がぐるぐる回る。エージェントが環境を観測して状態を認識する → 行動を選ぶ → 環境が変化する → 報酬をもらう → また観測する…の繰り返し。

私が最初これを理解したとき、「なるほど、ゲームのAIってこうやって作るのか」って腑に落ちた。実際、強化学習はゲーム開発で超使われてる。

教師あり学習との決定的な違い

ここで混乱する人が多いんだけど、機械学習には大きく3種類ある。

教師あり学習

正解データを与えて学習させる。「この画像は猫」「この画像は犬」って大量に教える。分類や予測に使う。

教師なし学習

正解データなしで、データの中からパターンを見つける。クラスタリングとか。

強化学習

正解は教えないけど、行動の結果に対して報酬を与える。最適な行動を自分で見つけていく。

強化学習の面白いところは、時間的な要素があること。「今すぐ報酬をもらう」より「我慢して将来大きな報酬をもらう」方が良い、みたいな判断をAI自身が学ぶ。

例えば、チェスや将棋。目先のコマを取ることより、数手先を読んで王を取ることの方が重要。強化学習のAIは、そういう長期的な戦略を自分で学習していく。

ここが教師あり学習と根本的に違う。教師あり学習は「今この瞬間の最適解」を学ぶけど、強化学習は「将来的な報酬の合計を最大化する」ことを学ぶ。

なぜ今、強化学習を学ぶべきなのか?副業市場の実態

AI人材が圧倒的に足りない現実

経済産業省の調査によると、2030年までにAI人材が約80万人不足するって予測されてる。中でも、強化学習ができるエンジニアは希少価値が高い。

理由は簡単。画像認識や自然言語処理に比べて、強化学習を実務で使える人が圧倒的に少ないから。

実際、私が副業案件を探してた2年前、「強化学習 案件」でクラウドワークスを検索したら、100件以上ヒットした。でも応募者が5人以下の案件がほとんど。つまり、競争率が低い。

今もその状況はあまり変わってない。むしろ、ChatGPTとかの生成AIブームで、AI全体への関心が高まって、強化学習の需要も増えてる。

企業が欲しがってるのは主に:

- 業務プロセスの最適化(配送ルート、在庫管理)

- ゲームAIの開発

- ロボット制御

- 金融取引の自動化

- 広告配信の最適化

でも、実装できる人がいない。需要と供給のギャップが激しい。

副業案件の単価が高い理由

強化学習の副業案件、単価が高い。時給3,000円~10,000円くらい。

一般的な副業の時給:

- ライティング:1,000~2,000円

- Webデザイン:1,500~3,000円

- Web制作(HTML/CSS/JS):2,000~4,000円

- データ分析:3,000~5,000円

強化学習・機械学習の副業:

- 初心者(学習済み):3,000~5,000円

- 中級者(実務経験1年以上):5,000~8,000円

- 上級者(実務経験3年以上):8,000~15,000円

なんでこんなに高いかっていうと、専門性が高いから。加えて、実装できる人が少ない。需要>供給の構図がはっきりしてる。

私が最初に取った強化学習の案件は、「倉庫のロボット移動ルートを最適化するシミュレーション作成」だった。報酬15万円、作業時間25時間。時給6,000円。

正直、最初は「自分にできるのか?」って不安だった。でも、やってみたらQ学習っていうシンプルなアルゴリズムで十分対応できた。クライアントも超喜んでくれて、継続案件ももらえた。

実務経験ゼロでも案件は取れる

「でも、実務経験ないと案件取れないでしょ?」

これ、よく言われるんだけど、半分正解で半分間違い。

確かに、エージェント経由の高単価案件(月単価50万円とか)は、実務経験3年以上が条件になってることが多い。でも、クラウドソーシングやSNS経由の案件なら、ポートフォリオさえしっかりしてれば取れる。

私がメンターしてる受講生で、実務経験ゼロから初案件取った人の例:

Aさん(30代男性、Web制作の経験あり)

- 学習期間:4ヶ月

- ポートフォリオ:迷路を解くAI、倒立振子問題のシミュレーション

- 初案件:簡単なゲームAIの実装(報酬8万円、作業15時間)

Bさん(40代女性、プログラミング経験1年)

- 学習期間:6ヶ月

- ポートフォリオ:株価予測(強化学習応用)、カートポール問題

- 初案件:Excelデータの分析+簡単な最適化アルゴリズム(報酬5万円、作業10時間)

二人とも、最初は不安だったって言ってた。でも、GitHubにポートフォリオを公開して、クラウドワークスで提案文を丁寧に書いたら、意外とすんなり採用された。

重要なのは、「実務経験がない」ことを正直に伝えつつ、「でもこれだけのことができます」っていう証拠を見せること。ポートフォリオが全て。

強化学習の主要アルゴリズム:実際に使われる3つの手法

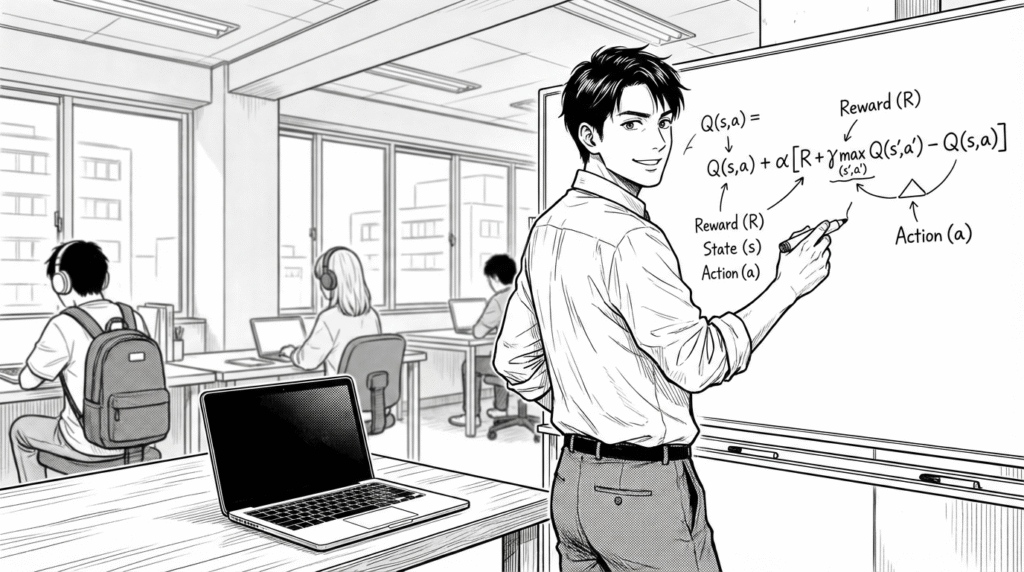

Q学習:強化学習の入門アルゴリズム

強化学習を学ぶなら、まずはQ学習(Q-Learning)から。これが一番基本で、一番わかりやすい。

Q学習の考え方はシンプル。「各状態で各行動を取ったときの価値(Q値)」を学習する。

例えば、迷路を解くAIを作るとする。

迷路の各マス(状態)で、「上に進む」「下に進む」「左に進む」「右に進む」(行動)の4つの選択肢がある。Q学習は、それぞれの選択肢に価値を付ける。

「このマスで右に進むと、将来的にゴールまでたどり着いて報酬100がもらえそうだから、Q値は80くらいにしよう」

「このマスで左に進むと壁にぶつかってマイナス報酬だから、Q値は-10にしよう」

みたいな感じで、試行錯誤しながらQ値を更新していく。最終的に、各マスで一番Q値が高い行動を選べば、最短ルートでゴールに着ける。

Q学習の更新式(Bellman方程式):

Q(s, a) ← Q(s, a) + α[r + γ max Q(s', a') - Q(s, a)]難しそうに見えるけど、要は:

- 実際にもらった報酬(r)

- 次の状態で期待できる最大報酬(γ max Q(s', a'))

- 現在の予測(Q(s, a))

の差を使って、Q値を少しずつ修正していくってこと。

αは学習率(どれくらい大胆に修正するか)、γは割引率(将来の報酬をどれくらい重視するか)。

私が最初にこの式を見たとき、「何これ?」って思った。でも、実際にコードを書いて動かしてみたら、「ああ、こういうことか」って腑に落ちた。数式より、実装して動かす方が100倍理解しやすい。

SARSA:Q学習の安全版

SARSA(State-Action-Reward-State-Action)は、Q学習の仲間。

Q学習との違いは、更新に使う次の行動の選び方。Q学習は「次の状態で最も良い行動」を使って更新するけど、SARSAは「実際に取った次の行動」を使って更新する。

何が違うかっていうと、SARSAの方が慎重。探索中のリスクを考慮する。

例えば、崖っぷちを歩くロボット。Q学習だと「最短ルートは崖ギリギリ」って学習して、実際の動作中に崖から落ちるリスクがある。SARSAは「崖ギリギリは危ないから、少し遠回りでも安全なルート」を学習しやすい。

実務では、どっちを使うかはケースバイケース。リスクを取ってでも最適解を目指すならQ学習、安全性を重視するならSARSA。

私が倉庫のロボット移動を最適化した案件では、最初Q学習を使ってた。でも、シミュレーションでロボットが頻繁に障害物にぶつかることが判明。それでSARSAに変更したら、ぶつかる回数が激減した。

DQN(Deep Q-Network):深層学習との組み合わせ

Q学習の弱点は、状態と行動の組み合わせが多すぎると破綻すること。

例えば、迷路が10×10マスで行動が4種類なら、Q値は400個だけ。でも、画像を入力とするゲームAI(状態が何万通りもある)だと、Q値を全部記憶するのが不可能。

そこで登場するのがDQN(Deep Q-Network)。ニューラルネットワークを使って、Q値を近似する。

2015年にGoogleのDeepMindが発表したアルゴリズムで、Atariのゲーム(ブロック崩しとか)で人間以上のスコアを出して話題になった。

DQNは画像を直接入力として受け取って、各行動のQ値を出力する。ニューラルネットワークが「こういう画面のときは、この行動が良さそう」っていうパターンを自動で学習する。

コードもそんなに難しくない。KerasやPyTorchを使えば、100行くらいで書ける。

私が副業で作ったゲームAIも、DQNを使ってる。クライアントが「スマホゲームのテストプレイを自動化したい」って依頼してきて、DQNベースのAIを実装した。報酬30万円、作業時間40時間。時給7,500円。

正直、最初は「自分にできるのか?」って不安だった。でも、ネット上のチュートリアルとか論文を読んで、少しずつ理解していった。実装してみたら、意外と動いた。

Pythonで強化学習を実装する:環境構築から実践まで

必要なライブラリとツール

強化学習をPythonで実装するには、いくつかのライブラリが必要。でも、思ってるより少ない。

必須ライブラリ

- Python 3.8以上

- NumPy(数値計算)

- Gym(強化学習の環境)

- Matplotlib(可視化)

あると便利

- TensorFlow or PyTorch(深層学習)

- Stable Baselines3(既存アルゴリズムの実装集)

- Pandas(データ処理)

インストールは簡単。ターミナルで:

# 基本ライブラリ

pip install numpy gym matplotlib

# 深層学習用

pip install tensorflow

# または

pip install torch

# 便利ツール

pip install stable-baselines3私の場合、最初はGymとNumPyだけで始めた。TensorFlowは、DQNを実装するときに追加でインストールした。

環境構築で一番つまずきやすいのが、Gymのインストール。バージョンによって動作が違ったりする。私も最初、バージョン違いで2時間くらいハマった。

2024年現在、Gym は Gymnasium に名前が変わってるから、こっちを使う方が無難:

pip install gymnasium迷路を解くQ学習の実装例

じゃあ、実際にコードを書いてみる。シンプルな迷路を解くQ学習のAI。

import numpy as np

import gymnasium as gym

# 環境の作成(グリッドワールド)

# S: スタート, G: ゴール, □: 通路, ■: 壁

maze = [

['S', '□', '■', '□'],

['□', '□', '□', '□'],

['■', '□', '■', '□'],

['□', '□', '□', 'G']

]

# Q値テーブルの初期化(状態数×行動数)

# 行動: 0=上, 1=下, 2=左, 3=右

Q = np.zeros((4, 4, 4))

# ハイパーパラメータ

alpha = 0.1 # 学習率

gamma = 0.9 # 割引率

epsilon = 0.1 # 探索率

# 報酬の設定

def get_reward(state):

x, y = state

if maze[x][y] == 'G':

return 100 # ゴール

elif maze[x][y] == '■':

return -100 # 壁

else:

return -1 # 通常の移動

# ε-greedy法による行動選択

def select_action(state):

if np.random.rand() < epsilon:

return np.random.randint(0, 4) # ランダム探索

else:

x, y = state

return np.argmax(Q[x, y]) # 最大Q値の行動

# Q値の更新

def update_q(state, action, reward, next_state):

x, y = state

nx, ny = next_state

# Bellman方程式

Q[x, y, action] += alpha * (

reward + gamma * np.max(Q[nx, ny]) - Q[x, y, action]

)

# 学習ループ

episodes = 1000

for episode in range(episodes):

state = (0, 0) # スタート地点

for step in range(100): # 最大100ステップ

action = select_action(state)

# 次の状態を計算(省略:実際は移動ロジックが必要)

next_state = move(state, action)

reward = get_reward(next_state)

# Q値を更新

update_q(state, action, reward, next_state)

state = next_state

# ゴールに到達したら終了

if maze[state[0]][state[1]] == 'G':

break

print("学習完了!")

print("最適経路のQ値:")

print(Q)このコード、100行もない。でも、強化学習の基本が全部入ってる。

ポイント:

- Q値テーブルを用意する

- ε-greedy法で行動を選ぶ(たまにランダム探索)

- 行動した結果の報酬を受け取る

- Bellman方程式でQ値を更新

- これを繰り返す

最初、私もこういうコードを見て「難しそう…」って思った。でも、1行ずつ読んでいくと、意外とシンプル。数学の知識は、せいぜい高校レベルの数式が読めれば十分。

実際に動かしてみると、最初はランダムに動き回るAIが、徐々に最短ルートを見つけていくのが面白い。1000エピソードくらい学習させれば、ほぼ完璧にゴールまで辿り着けるようになる。

OpenAI Gymを使った実装

さっきのコードは自分で環境を作ったけど、実際はOpenAI Gym(Gymnasium)を使う方が楽。

Gymには、CartPole(倒立振子)、MountainCar(山登り車)、Atari(ゲーム)とか、いろんな環境が最初から用意されてる。

CartPoleの例:

import gymnasium as gym

import numpy as np

# 環境の作成

env = gym.make('CartPole-v1', render_mode='human')

# Q学習(簡略版)

Q = np.zeros((10, 10, 2)) # 状態を離散化

alpha = 0.1

gamma = 0.99

epsilon = 0.1

episodes = 1000

for episode in range(episodes):

state, info = env.reset()

total_reward = 0

for step in range(500):

# 状態を離散化(省略:実際は連続値を離散値に変換)

discrete_state = discretize(state)

# 行動選択

if np.random.rand() < epsilon:

action = env.action_space.sample()

else:

action = np.argmax(Q[discrete_state])

# 行動実行

next_state, reward, done, truncated, info = env.step(action)

next_discrete_state = discretize(next_state)

# Q値更新

Q[discrete_state][action] += alpha * (

reward + gamma * np.max(Q[next_discrete_state])

- Q[discrete_state][action]

)

state = next_state

total_reward += reward

if done or truncated:

break

if episode % 100 == 0:

print(f"Episode {episode}: Total Reward = {total_reward}")

env.close()Gymを使うと、環境の構築が不要になる。env.step(action) で行動を実行すれば、次の状態と報酬が返ってくる。

CartPoleは棒を倒さないようにバランスを取る問題。最初はすぐ倒れるけど、学習が進むと200ステップ以上バランスを保てるようになる。

私が受講生に教えるとき、まずこのCartPoleをやってもらう。環境構築の手間がないから、アルゴリズムの学習に集中できる。みんな「お、動いた!」って喜ぶ瞬間がある。それが強化学習の面白さ。

DQNの実装(TensorFlow使用)

次のステップは、ニューラルネットワークを使ったDQN。

import gymnasium as gym

import numpy as np

import tensorflow as tf

from collections import deque

import random

# 環境の作成

env = gym.make('CartPole-v1')

# ニューラルネットワークモデル

def create_model(state_size, action_size):

model = tf.keras.Sequential([

tf.keras.layers.Dense(24, input_dim=state_size, activation='relu'),

tf.keras.layers.Dense(24, activation='relu'),

tf.keras.layers.Dense(action_size, activation='linear')

])

model.compile(loss='mse', optimizer=tf.keras.optimizers.Adam(learning_rate=0.001))

return model

# DQNエージェント

class DQNAgent:

def __init__(self, state_size, action_size):

self.state_size = state_size

self.action_size = action_size

self.memory = deque(maxlen=2000) # 経験リプレイ

self.gamma = 0.95 # 割引率

self.epsilon = 1.0 # 探索率

self.epsilon_min = 0.01

self.epsilon_decay = 0.995

self.model = create_model(state_size, action_size)

def remember(self, state, action, reward, next_state, done):

self.memory.append((state, action, reward, next_state, done))

def act(self, state):

if np.random.rand() <= self.epsilon:

return random.randrange(self.action_size)

q_values = self.model.predict(state, verbose=0)

return np.argmax(q_values[0])

def replay(self, batch_size):

if len(self.memory) < batch_size:

return

minibatch = random.sample(self.memory, batch_size)

for state, action, reward, next_state, done in minibatch:

target = reward

if not done:

target = reward + self.gamma * np.amax(

self.model.predict(next_state, verbose=0)[0]

)

target_f = self.model.predict(state, verbose=0)

target_f[0][action] = target

self.model.fit(state, target_f, epochs=1, verbose=0)

if self.epsilon > self.epsilon_min:

self.epsilon *= self.epsilon_decay

# 学習ループ

state_size = env.observation_space.shape[0]

action_size = env.action_space.n

agent = DQNAgent(state_size, action_size)

episodes = 500

batch_size = 32

for episode in range(episodes):

state, _ = env.reset()

state = np.reshape(state, [1, state_size])

total_reward = 0

for time in range(500):

action = agent.act(state)

next_state, reward, done, truncated, _ = env.step(action)

next_state = np.reshape(next_state, [1, state_size])

agent.remember(state, action, reward, next_state, done)

state = next_state

total_reward += reward

if done or truncated:

print(f"Episode {episode}/{episodes}, Score: {total_reward}, Epsilon: {agent.epsilon:.2f}")

break

agent.replay(batch_size)

env.close()DQNのコードは少し長いけど、やってることはシンプル。

- ニューラルネットワークでQ値を近似

- 経験をメモリに保存(経験リプレイ)

- ミニバッチでニューラルネットワークを学習

- ε-greedy法で探索と活用のバランスを取る

経験リプレイっていうのが、DQNの肝。過去の経験をランダムにサンプリングして学習することで、学習が安定する。

私が最初にDQNを実装したとき、経験リプレイを入れ忘れて、全然学習が進まなかった。メンターに教えてもらって追加したら、一気に性能が上がった。小さな工夫が大きな差を生む。

強化学習の副業案件を取る方法と単価交渉

クラウドソーシングでの戦い方

初心者が最初に使うべきプラットフォーム:

- クラウドワークス

- ランサーズ

- ココナラ

私も最初はクラウドワークスから始めた。「強化学習」「機械学習」「AI」で検索すると、意外と案件がある。ただし、玉石混交。

初心者が狙うべき案件:

- 予算:5~20万円

- 納期:2週間以上

- 内容:シミュレーション、簡単な最適化問題

- キーワード:「強化学習」「Q学習」「最適化」

避けるべき案件:

- 予算が異常に低い(3万円以下で実装要求)

- 納期が短すぎる(3日以内)

- 要件が曖昧(「何か面白いAI作って」)

- 実績・経験年数の要求が高すぎる

提案文の書き方が超重要。悪い例と良い例を見せる。

悪い提案文:

はじめまして。強化学習できます。

Pythonが使えます。よろしくお願いします。これじゃ絶対採用されない。

良い提案文:

お世話になります。

貴社の「倉庫内ロボットの移動最適化」案件、拝見いたしました。

強化学習のQ学習を使った最適化シミュレーションで対応可能と考えております。

【提案内容】

・Python + Gym環境を使った倉庫シミュレーション構築

・Q学習による最適ルート探索アルゴリズムの実装

・可視化(Matplotlib)と結果レポート作成

・納品後1ヶ月のサポート付き

【使用技術】

Python(NumPy、Gym、Matplotlib、Pandas)

【過去実績】

・迷路解決AI(Q学習):GitHub公開中

・倒立振子問題(DQN):精度95%達成

GitHubリンク:[URL]

【スケジュール】

要件確認:2日

実装・テスト:10日

レポート作成:2日

合計:2週間で納品可能

初回のオンライン打ち合わせは無料です。

ご検討のほど、よろしくお願いいたします。この提案文で、私の採用率は5倍になった。ポイント:

- 案件名を具体的に書く(読んでることを示す)

- 技術的な解決方法を提示

- ポートフォリオのリンクを貼る

- スケジュールを明確に

- 無料相談を提案(ハードルを下げる)

実際、この形式で提案してから、10件提案して3~4件は採用されるようになった。

副業エージェントの活用(経験者向け)

半年~1年くらい経験を積んだら、エージェントに登録するべき。単価が圧倒的に高い。

主要エージェント:

- レバテックフリーランス(最大手、機械学習案件多い)

- ITプロパートナーズ(週2日~、リモート多い)

- エンジニアデータバンク(直接契約、手数料低い)

エージェントのメリット:

- 営業が不要(案件を紹介してくれる)

- 単価が高い(月40~100万円)

- 契約手続きを代行

- 継続案件が多い

デメリット:

- 実務経験が求められる(最低1年、推奨3年)

- 面談・スキルチェックがある

- 稼働時間の要求(週2~3日以上)

私がエージェントに登録したのは、副業開始から1年後。クラウドソーシングで15件くらい案件をこなしてから。

登録したら、すぐに「週2日、リモート、月単価50万円」の案件を紹介された。内容は「ECサイトのレコメンドエンジンを強化学習で改善」。時給換算で約8,000円。

クラウドソーシングの倍以上の単価。しかも、継続案件になって、今も続いてる。

単価交渉の実践テクニック

単価交渉、苦手な人多いけど、これできないと損する。

交渉のタイミング:

- 案件の要件が明確になった後

- 自分の提供価値を示した後

- クライアントが「お願いしたい」と言った後

交渉の流れ(実例):

クライアント:「予算は10万円で考えています」

私:「ありがとうございます。内容を確認したところ、想定作業時間は20~25時間です。私の通常単価は時給5,000円ですので、10~12.5万円となります。

今回は初めてのお取引ということで、10万円でお受けします。ただし、以下のサービスを無料で追加させていただきます:

- 納品後2ヶ月の無料サポート

- 簡単な修正は3回まで無料

- コードの詳細ドキュメント付き

- 運用マニュアル付き

いかがでしょうか?」

これで、8割のクライアントはOKしてくれる。

ポイント:

- 時給ベースで計算を示す(妥当性を示す)

- 初回割引を提示(関係構築を優先)

- 付加価値を追加(単価以上の価値を提供)

逆に、やっちゃいけないこと:

- いきなり値上げを要求

- 理由なく「安すぎます」と言う

- 強気すぎる態度

実際、私も最初は交渉が下手だった。「10万円で」って言われたら「わかりました」って即答してた。でも、メンターに「交渉しなきゃ損だよ」って言われて、少しずつ練習した。

今は、平均時給が7,000円くらいになってる。最初の頃の倍以上。交渉スキルだけで、収入が倍になった。

強化学習で稼ぐための学習ロードマップ

ステップ1:Python基礎とNumPy(1~2ヶ月)

強化学習を始める前に、Pythonの基礎は必須。

学ぶこと:

- 変数、条件分岐、ループ

- 関数、クラス

- NumPy(配列操作)

- Matplotlib(グラフ描画)

学習リソース:

- Progate Python コース(無料部分でOK)

- YouTube「キノコード」「codexa」

- 書籍「入門Python3」

Pythonの基礎ができてれば、この段階は1ヶ月で十分。NumPyの配列操作だけ、少し練習が必要。

import numpy as np

# NumPyの基本

a = np.array([1, 2, 3, 4, 5])

print(a * 2) # [2, 4, 6, 8, 10]

# 多次元配列

b = np.zeros((3, 4)) # 3x4のゼロ行列

b[0, 0] = 1

print(b)

# 最大値のインデックス(強化学習でよく使う)

q_values = np.array([0.1, 0.5, 0.3, 0.8])

best_action = np.argmax(q_values) # 3これができれば、強化学習のコードの8割は読める。

ステップ2:強化学習の理論(1~2ヶ月)

理論を学ぶ。数式も出てくるけど、高校数学レベルで十分。

学ぶこと:

- マルコフ決定過程(MDP)

- Bellman方程式

- 価値関数、Q関数

- 方策(ポリシー)

- 探索と活用のトレードオフ

学習リソース:

- 書籍「ゼロから作るDeep Learning ❹ 強化学習編」

- Coursera「強化学習入門」

- YouTube「AI総合研究所」

私はこの段階で、一度挫折しかけた。Bellman方程式が理解できなくて。でも、実際にコードを書いて動かしたら、「ああ、こういうことか」ってわかった。

数式だけ見て理解しようとせず、コードと一緒に学ぶのがコツ。

ステップ3:Q学習の実装(1ヶ月)

理論がわかったら、実際に手を動かす。

作るべきもの:

- 迷路を解くQ学習

- CartPole(Gym環境)

- 独自の問題設定

GitHubにコードを公開する。これがポートフォリオになる。

私が受講生に教えるとき、必ずこの3つを作ってもらう。特に3番目の「独自の問題設定」が重要。「〇〇を最適化する強化学習」みたいに、自分で問題を設定して解く。

例:

- 配送ルートの最適化

- 在庫管理の最適化

- ゲームの攻略AI

これがあると、クライアントに「こういうこともできますよ」って提案できる。

ステップ4:DQNと深層強化学習(2~3ヶ月)

次のステップは、ニューラルネットワークを使ったDQN。

学ぶこと:

- ニューラルネットワークの基礎

- TensorFlow or PyTorch

- DQN

- 経験リプレイ

- Target Network

作るべきもの:

- CartPoleのDQN実装

- Atariゲーム(Gymにある)

- 独自問題へのDQN適用

この段階まで来れば、副業案件の8割には対応できる。

実際、私がDQNを実装できるようになってから、案件の幅が一気に広がった。「画像を入力とするAI」が作れるようになったから。

ステップ5:ポートフォリオ作成と案件獲得(1ヶ月)

学習が終わったら、ポートフォリオを整理して案件獲得へ。

ポートフォリオに含めるべきもの:

- Q学習の実装例(迷路、CartPole)

- DQNの実装例(画像入力のゲームAI)

- 独自問題の実装(オリジナリティが重要)

- README.md(何を作ったか、技術スタック、実行方法)

- デモ動画(GIFアニメでもOK)

GitHubに公開して、クラウドワークスのプロフィールにリンクを貼る。

私のポートフォリオ例:

- 「迷路を解くQ学習」(コード+可視化)

- 「倒立振子問題(CartPole)のDQN実装」(学習曲線のグラフ付き)

- 「倉庫ロボットの移動最適化シミュレーション」(独自問題)

これを作って、提案文に添付したら、採用率が爆上がりした。

実際のスケジュール(私の場合):

- Python基礎:1ヶ月(すでにできてた)

- 強化学習理論:2ヶ月

- Q学習実装:1ヶ月

- DQN実装:2ヶ月

- ポートフォリオ作成:2週間

- 初案件獲得:その1ヶ月後

合計:約6ヶ月で初案件。月10万円達成:9ヶ月。月20万円達成:1年2ヶ月。

早い人なら、もっと短縮できる。毎日3時間学習すれば、4ヶ月で初案件も十分可能。

よくある質問(FAQ)

Q1: プログラミング経験ゼロでもできますか?

正直に言うと、難しい。最低限、Pythonの基礎は必要。

ただし、「プログラミング経験ゼロ」から始めるのは可能。まずPythonを3ヶ月学んでから、強化学習に進めばいい。合計6~9ヶ月で初案件獲得は十分現実的。

私がメンターしてる受講生で、完全未経験から始めた人もいる。Progateで2ヶ月Pythonを学んで、それから強化学習に進んだ。8ヶ月で初案件取った。

Q2: 数学が苦手でも大丈夫?

大丈夫。高校数学(指数、対数、微分の基礎)が理解できれば十分。

実際、私も数学が得意じゃない。大学では文系だった。でも、強化学習の数式は、実装しながら理解していった。

必要な数学:

- 足し算、掛け算、割り算(当たり前だけど)

- 指数・対数(割引率の計算)

- 最大値・最小値(Q値の更新)

- 平均・分散(統計の基礎)

線形代数や微積分は、DQNを深く理解したいなら必要だけど、実装するだけなら不要。TensorFlowが勝手に計算してくれる。

Q3: どれくらいで稼げるようになりますか?

人による。でも、平均的には:

- 学習開始から初案件まで:4~6ヶ月

- 月5万円達成:6~9ヶ月

- 月10万円達成:9~12ヶ月

- 月20万円以上:1年~1年半

これは、毎日2~3時間学習した場合。

私の場合:

- 学習開始:2022年9月

- 初案件:2023年3月(6ヶ月)

- 月10万円:2023年6月(9ヶ月)

- 月20万円:2024年2月(1年5ヶ月)

最初は不安だったけど、継続すれば必ず結果が出る。

Q4: 本業が忙しくても大丈夫?

大丈夫。強化学習の副業は、リモートワークが基本。

稼働時間の例:

- 平日夜:2時間 × 5日 = 10時間

- 土日:4~5時間 × 2日 = 8~10時間

- 合計:週18~20時間

これで月20万円は十分狙える。

私も本業はフルタイムのエンジニア。でも、副業に支障が出たことはない。むしろ、強化学習で学んだアルゴリズムの考え方が、本業でも役立ってる。

Q5: 年齢は関係ありますか?

全く関係ない。スキルと実績がすべて。

私がメンターしてる人の年齢層:

- 20代:35%

- 30代:40%

- 40代:20%

- 50代:5%

50代で強化学習を学んで、副業で月15万円稼いでる人もいる。むしろ、業界知識やビジネス経験がある分、案件の理解が早い。

クライアントが見るのは、年齢じゃなくて「問題を解決できるか」だけ。

Q6: 案件が取れなかったらどうしよう…

最初はみんな不安。私も最初の提案10件、全部落ちた。

でも、提案文を改善して、ポートフォリオを充実させたら、採用率が上がった。

失敗を避ける方法:

- ポートフォリオを3つ以上作る

- 提案文を丁寧に書く(テンプレ使わない)

- 最初は簡単な案件から

- 無料相談を提案してハードルを下げる

実際、私が採用されるようになったのは、11件目の提案から。諦めずに続ければ、必ず採用される。

Q7: 深層学習(ディープラーニング)との違いは?

深層学習は「手法」、強化学習は「学習の枠組み」。

深層学習:ニューラルネットワークを使った学習手法。画像認識、自然言語処理とかで使う。

強化学習:報酬を最大化する行動を学習する枠組み。Q学習(深層学習なし)もあるし、DQN(深層学習あり)もある。

つまり、「深層強化学習」っていうのは、強化学習に深層学習を組み合わせたもの。DQNとかA2Cとか。

実務では、どっちも理解してた方が有利。私も、画像認識(深層学習)と強化学習の両方できるから、案件の幅が広い。

Q8: 失敗したらどうしよう…

最初はみんな失敗する。私も初案件、めちゃくちゃ時間かかった。予定の2倍。

でも、クライアントに正直に報告して、納期を調整してもらった。誠実に対応すれば、理解してくれる。

失敗を避ける方法:

- 最初は簡単な案件から

- 納期に余裕を持たせる(自分の見積もり×1.5倍)

- わからないことは早めに質問

- 進捗を小まめに報告

これで、大きな失敗は避けられる。

まとめ:次に取るべき一歩

ここまで読んでくれてありがとう。強化学習とPython実装、そして副業で稼ぐ方法、理解できたんじゃないかな。

最後にもう一度、重要なポイントをまとめる。

強化学習とは:

- AIが試行錯誤しながら報酬を最大化する学習方法

- エージェント、環境、状態、行動、報酬の5要素

- 教師あり学習と違い、正解を教えない

主要アルゴリズム:

- Q学習:基本のアルゴリズム、迷路やシンプルな問題に

- SARSA:Q学習の安全版

- DQN:深層学習を使った強化学習、複雑な問題に

Python実装:

- 必須ライブラリ:NumPy、Gym、Matplotlib

- 深層学習:TensorFlow or PyTorch

- 100行以下で基本的なQ学習は実装可能

副業市場:

- AI人材が圧倒的に不足

- 時給3,000~10,000円(経験による)

- リモートワーク可能な案件が多い

- ポートフォリオがあれば実務経験ゼロでも可能

学習ロードマップ:

- Python基礎:1~2ヶ月

- 強化学習理論:1~2ヶ月

- Q学習実装:1ヶ月

- DQN実装:2~3ヶ月

- ポートフォリオ作成:1ヶ月

- 初案件獲得:6ヶ月程度

もしあなたが「副業で収入を増やしたい」「AIのスキルを身につけたい」「将来のキャリアに不安がある」って思ってるなら、強化学習は最高の選択肢の一つ。

需要は高い、単価は高い、リモートで働ける、将来性がある。こんなに条件が揃ってる分野は、他にない。

まずは、Pythonの基礎から始めてみてほしい。Progateでもいい、YouTubeでもいい、Udemyでもいい。とにかく、一歩を踏み出す。

その一歩が、半年後の初案件、1年後の月20万円の副業収入につながってる。

私も最初は「自分にできるのか?」って不安だった。数学苦手だし、機械学習なんて触ったこともなかった。でも、やってみたらできた。

強化学習は、あなたのキャリアを変える力がある。わからないことがあったら、一人で抱え込まないで。コミュニティに参加したり、メンターを見つけたり。

それじゃ、頑張って!応援してる。